用 AI 技能(Skills)自动生成测试用例:让代码更可靠,开发更高效

在软件开发的全流程中,测试是保障质量的关键一环。然而,编写全面、高效的测试用例往往耗时费力——既要覆盖各种边界条件,又要模拟异常场景,还要保持与业务逻辑同步更新。有没有一种方式,能让我们从重复劳动中解放出来,同时提升测试覆盖率?

答案是:有!借助 AI 的“技能”(Skills),我们可以自动生成高质量的测试用例。

什么是“Skills”?为什么它能生成测试用例?

在当前主流的大模型平台(如阿里通义、OpenAI、GitHub Copilot 等)中,“Skills”指的是一组经过封装、可调用的 AI 能力模块。这些模块可以理解特定任务(比如“生成单元测试”),并基于上下文自动执行。

例如,在通义千问(Qwen)生态中,你可以通过调用 test-generation 技能,输入一段函数代码,AI 就会为你:

- 自动生成符合语言规范的单元测试(如 pytest、JUnit、Jest 等);

- 覆盖正常路径、边界值和异常情况;

- 输出可直接运行的测试脚本;

- 甚至根据代码变更智能推荐新增测试点。

这不仅节省了大量人工时间,还能显著提升测试的完整性与一致性。

实战演示:三步生成 Python 单元测试

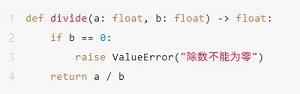

假设你有如下一个简单的 Python 函数:

在支持 Skills 的 IDE 插件或 API 中,选中该函数,点击“生成测试用例”(或通过自然语言指令:“为 divide 函数生成 pytest 测试”)。

Skill 会解析函数签名、条件分支和异常抛出点,识别出关键测试场景:

- 正常除法(如 10 / 2)

- 除数为零(应抛出 ValueError)

- 负数、小数等边界值

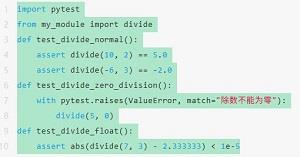

- 第三步:输出可运行的测试代码

AI 生成如下 pytest 代码:

只需一键,测试即就绪!

为什么开发者应该拥抱 AI 测试生成?

- 提升效率:原本需要 30 分钟编写的测试,现在 10 秒完成。

- 减少遗漏:AI 不会“忘记”写某个边界 case。

- 保持同步:当函数逻辑变更时,重新生成测试即可快速验证兼容性。

- 降低门槛:新手开发者也能写出结构良好的测试代码。

当然,AI 生成的测试仍需人工 review —— 它是助手,不是替代者。但毫无疑问,它正在成为现代 DevOps 流程中的“超级加速器”。

未来展望:测试即代码,代码即测试

随着 AI Skills 的不断进化,未来的测试将更加智能:

- 自动生成集成测试与端到端测试;

- 结合代码覆盖率工具,动态补全缺失路径;

- 与 CI/CD 深度集成,实现“提交即测、问题即报”。

我们正迈向一个测试自动化 + 智能化的新时代。而今天,你就可以开始尝试用 Skills 为你的项目注入“自愈”能力。

可靠的代码,从一份好测试开始;而好测试,现在可以由 AI 帮你写。